هل يهدد الذكاء الاصطناعي بياناتك؟ تعرّف على المخاطر والحلول الفعّالة

بينما يغيّر الذكاء الاصطناعي الطريقة التي نعيش ونعمل بها، يتصاعد قلق عالمي بشأن مصير البيانات الشخصية. فمن تتبع السلوك إلى تحليل الصور والتسجيلات، تدخل الأنظمة الذكية في تفاصيل دقيقة من حياتنا.

نستعرض، في هذا المقال، أبرز مخاطر الذكاء الاصطناعي على البيانات الشخصية والخصوصية الرقمية للمستخدمين، ونقدّم حلولاً عملية وتقنية لحماية بياناتك من الاستخدام غير المصرّح به.

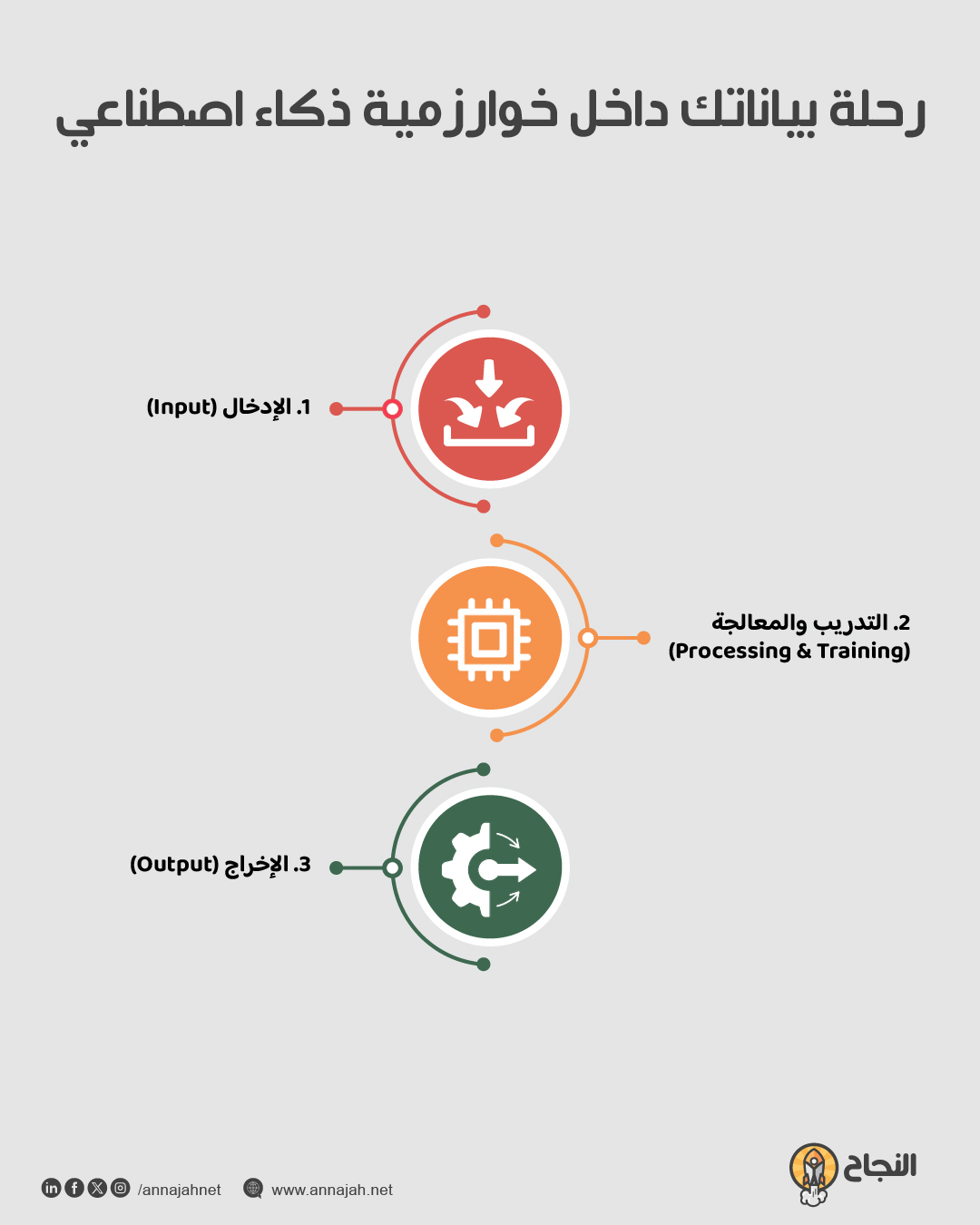

كيف يجمع الذكاء الاصطناعي البيانات الشخصية؟

"الذكاء الاصطناعي لا يخترق البيانات مباشرة، بل يتغذى على كل ما تشاركه طواعية أو دون وعي عبر الأجهزة والتطبيقات".

الذكاء الاصطناعي لا يعمل بمعزل عن العالم، بل يتغذّى على البيانات – وكلما كانت أكثر تنوعاً وثراءً، زادت دقة مخرجاته. المشكلة؟ أن هذه البيانات في كثير من الأحيان تشمل معلومات شديدة الخصوصية عن الأفراد، تُجمع دون علمهم أو بموافقة غامضة مدفونة في شروط استخدام طويلة.

هذا ما يجعل مخاطر الذكاء الاصطناعي على البيانات الشخصية من أكبر التحديات التي تواجه مستخدمي التكنولوجيا اليوم. في ما يلي، نستعرض كيف تتم عملية الجمع هذه، ومن أين، وبأية تقنيات.

مصادر البيانات: التطبيقات، الكاميرات، المواقع، تفاعلات الشبكات

لا يتطلب الذكاء الاصطناعي أن تدخل بياناتك يدوياً، فهو قادر على التقاطها من مئات القنوات النشطة.

تطبيقات الهاتف الذكي هي أول وأبرز مصدر، إذ تجمع معلومات عن موقعك الجغرافي، أو عاداتك اليومية، أو تفضيلاتك الشرائية، أوحتى من سجلّ تصفحك؛ إذ إنّك غالباً ما تُشارك هذه البيانات مع شركات أخرى لأغراض "تحليلية".

بعدها، يأتي كاميرات المراقبة العامة، والتي لم تعد فقط لتسجيل الصور، بل باتت مجهّزةً بأنظمة ذكية تتابع السلوكات وتفسّر التحركات. فإن كنت تعتقد أن الخصوصية محفوظة على الإنترنت، ففكّر مجدداً.

تفاعلاتك على وسائل التواصل الاجتماعي – من الإعجاب إلى التعليق – تُحلل باستمرار لبناء نموذج شخصي لك.

كل هذه القنوات تُغذي أنظمة الذكاء الاصطناعي بخريطة دقيقة عنك، ما يفتح الباب واسعاً أمام مخاطر الذكاء الاصطناعي على البيانات الشخصية من خلال سوء الاستخدام، التسريب، أو التوظيف في حملات تسويقية أو سياسية دون إذنك.

تقنيات: التعلم العميق، التعرّف على الوجه، تحليل الصوت

حتى لو لم تُدخل بياناتك في تطبيق معين، فإن الذكاء الاصطناعي يمتلك تقنيات متقدمة لاستخراجها بصورة غير مباشرة؛ من أبرزها:

1. التعلم العميق (Deep Learning)

يستخدم لاكتشاف الأنماط في البيانات السلوكية، وربطها بتوقّعات دقيقة حول هويتك وتفضيلاتك.

2. التعرّف على الوجه (Facial Recognition)

يُستخدم لتحديد الأشخاص من خلال الصور ومقاطع الفيديو، ويُطبّق حتى في الأماكن العامة بدون تصريح مباشر من الأفراد.

3. تحليل الصوت (Voice Analysis)

يمكن للنظام تحليل نبرة صوتك والتقاط مشاعرك، حالتك النفسية، أو حتى مدى صدقك، بناءً فقط على مكالمة قصيرة.

تكمن الخطورة في أن هذه التقنيات تخترق الخصوصية بصمت، وتحوّل حياتنا اليومية إلى مصدر بيانات مستمر. هنا، يظهر جلياً أحد أعقد مخاطر الذكاء الاصطناعي على البيانات الشخصية.

إذ يتم جمع وتحليل معلومات حساسة دون موافقة صريحة أو إشراف تنظيمي كافٍ، مما يخلق فجوة أخلاقية وقانونية تتسع يوماً بعد يوم.

وفقاً لمقال من مؤسسة (Privacy in an AI Era) التابعة لجامعة ستانفورد، تعتمد تقنيات الذكاء الاصطناعي على جمع بيانات شخصية متنوعة من التطبيقات، والكاميرات، ومواقع الإنترنت، وتحليل الصوت باستخدام التعلم العميق وخوارزميات التعرّف على الوجه.

أبرز المخاطر التي تهدد خصوصيتك

"أكثر المخاطر شيوعاً تشمل الاستخدام غير المصرّح به، والمراقبة الخفية، واستغلال البيانات في الإعلانات أو التقييمات الآلية".

مع توسّع قدرات الذكاء الاصطناعي، تتزايد المخاوف من طريقة تعامله مع المعلومات الحساسة. بعض هذه المخاطر واضحة، مثل تسريب البيانات، والبعض الآخر أكثر خفاءً، كأن يتم تتبّعك رقمياً دون أن تدري. هنا نسلّط الضوء على أبرز التهديدات التي تواجه الخصوصية في ظل تنامي استخدام هذه التقنيات:

1. التتبع الخوارزمي والاستهداف الإعلاني

وراء كل إعلان يظهر لك "في الوقت المناسب"، هناك خوارزمية تتبّع بدقة نشاطاتك عبر الإنترنت. الذكاء الاصطناعي يتعلّم من سلوكاتك – ما تقرأ، ما تشتري، حتى ما تفكّر فيه أحياناً – ليرسم عنك ملفاً رقمياً يُستخدم لاحقاً في توجيه الإعلانات بدقة متناهية.

في البداية، قد يبدو الأمر مفيداً. لكنّ الحقيقة أنّ هذا النوع من التتبع يدخل في عمق الخصوصية، ويفتح الباب واسعاً أمام مخاطر الذكاء الاصطناعي على البيانات الشخصية، لا سيما عندما تُستخدم تلك البيانات خارج السياق التجاري، في التأثير في الآراء أو التوجهات الشخصية.

2. تسريب البيانات من نماذج الذكاء الاصطناعي

أحد التهديدات التي لا يتحدث عنها كثيرون هو أن نماذج الذكاء الاصطناعي ذاتها قد تصبح مصدر تسريب. بعض النماذج – خصوصاً تلك المبنية على تعليمات مستخدمين – قد تخزن أجزاء من المعلومات الحساسة التي تدخلها، مثل كلمات المرور أو تفاصيل شخصية.

وفي سياق مخاطر الذكاء الاصطناعي على البيانات الشخصية، يمكن اعتبار هذه التسريبات كارثية لأنها تحصل دون قصد، لكن نتائجها جسيمة. الأسوأ من ذلك، أن المستخدم غالباً لا يدرك أن بياناته ما زالت "حية" داخل نموذج يُستخدم لاحقاً لمستخدمين آخرين.

3. غياب الشفافية في كيفية استخدام البيانات

أين تذهب بياناتك بعد أن تُدخلها؟ من يراها؟ ولأي غرض تُستخدم؟ غالباً، لا تحصل على إجابة واضحة. يُعرف هذا بـ"فقدان الشفافية" – إحدى أسوأ مخاطر الذكاء الاصطناعي على البيانات الشخصية.

تحتفظ عديدٌ من الشركات بسياسات خصوصية غامضة، أو تُخفي تفاصيل استخدام البيانات وراء مصطلحات قانونية معقدة. يمنع هذا الغموض المستخدم من اتخاذ قرارات مستنيرة، ويُمهّد الطريق لإساءة استخدام البيانات دون رقابة فعليّة.

شاهد بالفديو: 10 نصائح تحفظ خصوصيتك على الإنترنت

4. استخدام الذكاء الاصطناعي في التجسس والمراقبة

عندما تُستخدم تقنيات الذكاء الاصطناعي في المراقبة الجماعية، يصبح كل تحرّك لك، كل محادثة، وكل موقع تزوره، عرضة للتحليل والتخزين. الحكومات والشركات الكبرى تستخدم الذكاء الاصطناعي لرصد أنماط السلوك والتعرّف على الأشخاص وحتى التنبؤ بنواياهم.

ما يجعل هذا الخطر فريداً هو أنّه يجري دون موافقة المستخدم، وفي بعض الحالات دون علمه، ما يعزز من مخاطر الذكاء الاصطناعي على البيانات الشخصية في أبعاد أمنية وسياسية.

حتى في المجتمعات التي تملك قوانين لحماية الخصوصية، تظلّ هناك ثغرات تُستغل من قِبل أنظمة المراقبة الذكية، ما يستدعي وقفة قانونية وأخلاقية صارمة تجاه استخدام هذه التقنيات.

وفقاً لمنظمة (DataGuard)، تشمل المخاطر الشائعة الاستخدام غير المصرّح به للبيانات، وتسريب البيانات من نماذج الذكاء الاصطناعي، والمراقبة الخفية، إضافة إلى الخطر الناتج عن الانحياز الخوارزمي.

كما تُشير مراجعة قانونية بصحيفة (California Law Review) إلى أن خوارزميات (AI) تميل إلى أن تكون سرية، ما يعزز مخاوف حول انتهاك الخصوصية وحقوق الإنسان.

.jpg_f109e8b93052544_large.jpg)

قوانين حماية البيانات أمام تحديات الذكاء الاصطناعي

"رغم وجود قوانين مثل (GDPR)، إلا أن الذكاء الاصطناعي يطرح تحديات جديدة تحتاج تحديثات قانونية متواصلة".

وفقاً للهيئة الأوروبية لحماية البيانات (EDPB)، رغم وجود قوانين مثل (GDPR)، إلا أنّ التقنيات القائمة على الذكاء الاصطناعي تطرح تحديات جديدة تستلزم تحديثات تشريعية خاصة، بما يشمل متطلبات التصميم القائم على الخصوصية ومراعاة التدخل البشري في النظم عالية المخاطر.

رغم التطور اللافت في التشريعات العالمية لحماية الخصوصية الرقمية، إلا أن مخاطر الذكاء الاصطناعي على البيانات الشخصية تفرض واقعاً قانونياً أكثر تعقيداً.

فالقوانين التقليدية مثل اللائحة العامة لحماية البيانات الأوروبية (GDPR)، التي تُعد من أكثر التشريعات صرامة، لم تُصمم في الأصل لمعالجة تحديات الذكاء الاصطناعي المتقدمة، ما يجعلها غير كافية في بعض السيناريوهات المعاصرة.

لا تكتفي الأنظمة الذكية اليوم بجمع المعلومات، بل تُحلل وتُخمّن وتُصنّف المستخدمين بناءً على سلوكهم أحياناً دون علمهم أو موافقتهم الصريحة، كما أن بعض الخوارزميات تُتخذ فيها قرارات حاسمة – كمنح قرض أو رفض طلب توظيف – دون أي تفسير واضح.

يفرض هذا كله ضرورة إدخال مفاهيم جديدة في التشريعات، مثل "الشفافية الخوارزمية" و"الحق في المراجعة البشرية" و"الخصوصية حسب التصميم".

بدأت عديدٌ من الدول تعديل قوانينها لمواكبة هذه التغيرات، مثل تحديثات قانون الذكاء الاصطناعي الأوروبي (EU AI Act) وقانون حماية المستهلك في كاليفورنيا (CCPA)، لكنها لا تزال في بداياتها.

أما في الدول العربية، فالحاجة ملحّة لإنشاء أطر قانونية تُنظّم كيفية استخدام الذكاء الاصطناعي، خصوصاً في ما يتعلق بـأمن البيانات وحماية الخصوصية الرقمية.

كيف تحمي بياناتك الشخصية من خوارزميات الذكاء الاصطناعي؟

"لحماية بياناتك: راجع الأذونات، واستخدم (VPN)، واختر تطبيقات تلتزم بسياسات خصوصية شفافة".

رغم تعدد مخاطر الذكاء الاصطناعي على البيانات الشخصية، لا يزال بالإمكان اتخاذ خطوات بسيطة، لكنّها فعالة للحد من هذه التهديدات. الحماية لا تتطلب بالضرورة خبرة تقنية متقدمة، بل وعي رقمي وسلوك حذر عند التعامل مع الأدوات والمنصات المختلفة.

إليك أبرز الإجراءات التي تساعدك على تأمين معلوماتك في هذا العصر الذكي:

1. تفعيل إعدادات الخصوصية المتقدمة

توفر التطبيقات ومنصات الويب معظمها الآن إعدادات خصوصية تفصيلية – لكنها عادةً تكون مخفية خلف عدة قوائم. يُنصح بالوصول إليها وتعديلها حسب المستوى الذي يناسبك. فعّل الخيارات التي تحد من تتبّع نشاطك، وراجع ما إذا كانت الأذونات تتناسب مع وظيفة التطبيق.

يُعد تفعيل إعدادات الخصوصية المتقدمة خط الدفاع الأول ضد مخاطر الذكاء الاصطناعي على البيانات الشخصية؛ لأنّه يمنع الوصول غير الضروري إلى الكاميرا، الموقع، أو الميكروفون.

2. استخدام أدوات منع التتبع وتشفير البيانات

واحدة من أكثر الطرائق فعالية لحماية نفسك هي استخدام أدوات منع التتبع (Anti-Tracking Tools) مثل (Privacy Badger) أو (uBlock Origin)، بالإضافة إلى متصفحات تدعم التصفّح الخفي بفعالية مثل (Brave) أو (Firefox).

لزيادة الأمان، يُفضّل أيضاً استخدام تطبيقات تشفير مثل (ProtonMail) للبريد، و(Signal) للمراسلات.

تُقيّد هذه الأدوات قدرة الذكاء الاصطناعي على تحليل سلوكك، مما يقلل من مخاطر الذكاء الاصطناعي على البيانات الشخصية مباشرةً.

3. اختيار التطبيقات التي تتبنى مبادئ الخصوصية

ليس كل التطبيقات متساوية من ناحية احترام الخصوصية. لذلك، اختر تلك التي تُعرف بسياسات شفافة في التعامل مع البيانات، مثل عدم البيع لأطراف ثالثة، أو تقديم ميزات حذف البيانات عند الطلب. ابحث عن التطبيقات مفتوحة المصدر أو تلك التي تحمل شهادات خصوصية من جهات مستقلة.

بهذه الطريقة، تقلل من فرصة وقوع معلوماتك ضحيةً في سيناريوهات تتعلّق بـمخاطر الذكاء الاصطناعي على البيانات الشخصية دون علمك.

4. التحقق من سياسة البيانات قبل منح الأذونات

قبل أن تضغط "قبول"، خذ لحظة لقراءة سياسة البيانات – حتى لو بسرعة. ابحث عن عبارات مثل "نشارك معلوماتك مع شركاء تسويق" أو "نستخدم بياناتك لتحسين خدماتنا"، فهي إشارات لاحتمال استغلال بياناتك تجاهل هذه السياسات قد يضعك في موقع هشّ أمام مخاطر الذكاء الاصطناعي على البيانات الشخصية لأنك عملياً تمنح الأذونات دون معرفة كيف سيتم استخدامها أو إلى من ستصل.

حسب شركة (EY) الاستشارية (Ernst & Young)، لا بد من تبنّي ممارسات 'الخصوصية حسب التصميم' طوال دورة حياة النظم الذكية، مثل التحقق من قانونية معالجة البيانات والحد من استخدامها، إضافة إلى تشجيع استخدام البيانات الاصطناعية عندما يتطلب الأمر وأدوات التشفير والمتابعة المستمرة.

أسئلة شائعة

1. هل يستخدم الذكاء الاصطناعي بياناتي دون إذن؟

في بعض الحالات، نعم. التطبيقات تجمع بياناتك حتى دون موافقة صريحة إن لم تُراجع الإعدادات.

2. كيف أعرف أن تطبيقي يشارك بياناتي؟

افتح إعدادات "الخصوصية" في هاتفك وتحقق من أذونات كل تطبيق.

3. ما الفرق بين جمع البيانات الشرعي والانتهاك؟

الشرعي يتطلب موافقة المستخدم، بينما الانتهاك يتم دون إذن أو بمعالجة غير شفافة.

4. هل يمكن محو بياناتي من أدوات الذكاء الاصطناعي؟

توفر بعض المنصات خاصية "طلب حذف البيانات"، ولكنها ليست متاحة دائماً.

5. ما هي أقوى أداة لحماية الخصوصية الرقمية اليوم؟

شبكات (VPN) موثوقة، إضافة إلى أدوات مثل (DuckDuckGo) و(Brave) و(Privacy Badger).

إقرأ أيضاً: الذكاء الاصطناعي: مفهومه وتاريخه وأهميته وأهدافه ووظائفه ومستقبله

في الختام

في عالم تغذّيه الخوارزميات، تصبح الخصوصية الرقمية أحد أهم حقوقك التي تحتاج للدفاع عنها بوعي وأدوات ذكية. لا تترك بياناتك عرضة للاستخدام غير المشروع. احمِ خصوصيتك مخاطر من الذكاء الاصطناعي على البيانات الشخصية، واتخذ خطوات وقائية اليوم، وشارك المقال مع من يهمك أمرهم لحماية بياناتهم كذلك.